プロンプトの先にあるもの

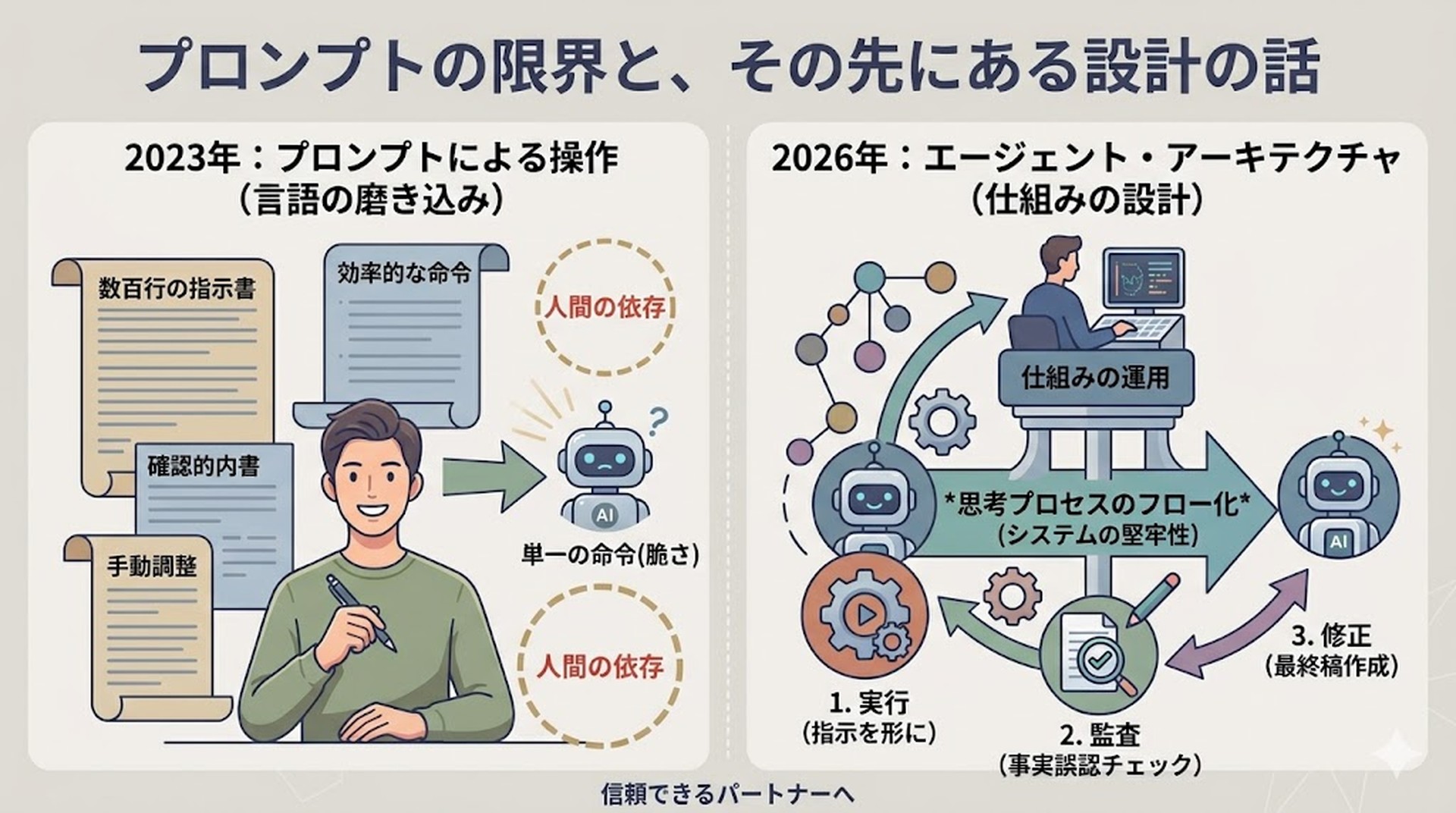

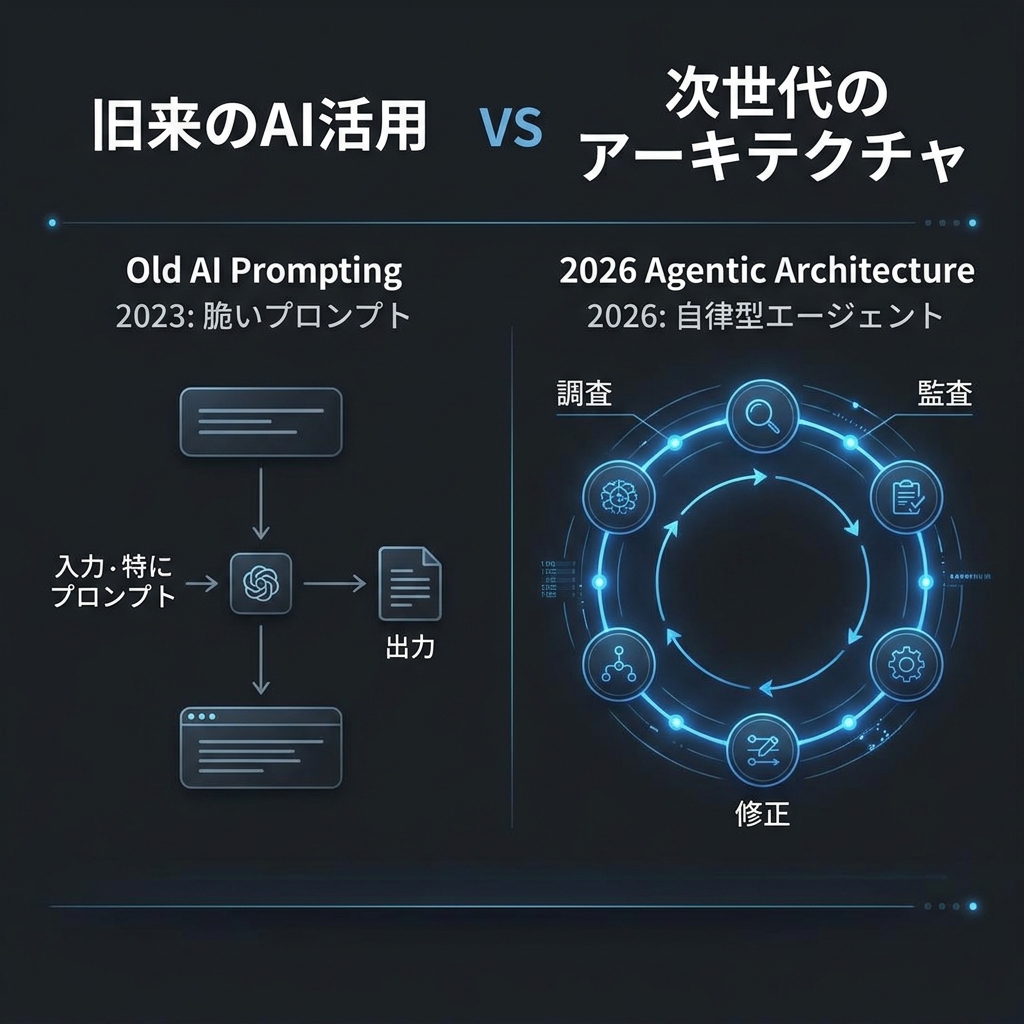

2023年頃、AIをいかに使いこなすかという「プロンプト」への関心が高まりました。

いかに効率的な命令文を書くか。それがAIを活用するための最短距離だと考えられていた時期です。

しかし、2026年現在の現場感は少し違います。

「言葉の選び方」を磨く段階から、「AIを動かす仕組みの設計(アーキテクチャ)」へと、関心が明確にシフトしています。

現場で直面した「脆さ」

私自身、かつては数百行の指示書を書き、AIの出力をコントロールしようと試行錯誤していました。

一見、それで意図した通りに動いているように見えます。

しかし、モデルがわずかに更新されたり、入力データの形式が少し変わったりするだけで、その指示書は機能しなくなります。昨日まで動いていたものが、今日は動かない。その度に人間が手動で調整し、また次のエラーを待つ。

この「人間が常にAIの出力を監視し、修正し続ける」という依存関係がある限り、それは本当の意味での自動化ではありません。単に、作業の形が変わっただけです。

「仕組み」で不確実性を抑え込む

現在取り組んでいるのは、単一の命令(プロンプト)に頼るのではなく、「複数の役割を組み合わせた仕組み」による解決です。

一つのタスクに対し、私は以下の3つの工程を設計しています。

- 実行: 指示を形にする。

- 監査: 事実誤認や論理の矛盾をチェックする。

- 修正: 監査の結果を反映し、最終稿を作る。

例えば、裏側で行われているのはこのようなやり取りです。

実行: 「コーヒーの抽出理論についての記事を作成しました」

監査: 「抽出温度の記述がソースデータと異なります。また、専門用語が多すぎます」

修正: 「指摘に基づき、温度設定を修正し、表現を平易に書き換えました」

AIに「一発で正解を出せ」と強いるのではなく、AI同士に「点検と修正」をさせる。

言葉でコントロールしようとするのをやめ、「思考のプロセス」そのものをフローとして組む。

これにより、AI特有の不確実性を、システムの堅牢性で抑え込むことが可能になります。

今日から試せること

大掛かりなシステムを組まなくても、考え方は今すぐ応用できます。

それは、AIに何かを作らせた後、同じAI(あるいは別のAI)に「今の回答の欠点や誤りを3つ指摘して」と命じることです。

そして、その指摘を元に自分で修正、あるいはAIに再提出させる。

「命令」を磨くのではなく、「工程(チェック機能)」を増やすこと。

この視点の切り替えが、AIを「便利なツール」から「信頼できるパートナー」に変える第一歩になります。

結びに

AIを外側から眺める段階は終わりました。

これからは、自分だけの「仕組み」をどう構築し、どう運用していくかが、仕事の質を左右します。

流行を追うのではなく、実装の現場で起きている事実に目を向けること。

その積み重ねの中にこそ、これからの技術との付き合い方があると考えています。